1. DNN (Deep Neural Network, 심층 신경망) 모델

- 여러 개의 은닉층을 가지는 인공 신경망 모델이다.

- 역전파 알고리즘을 통해 학습하며, 입력 데이터가 네트워크를 통과하면서 가중치가 조정되어 목표 출력과의 오차를 최소화한다.

- 복잡한 비선형 문제를 해결할 수 있으며, 이미지, 음성, 텍스트 등 다양한 분야에 적용 가능하다.

- 컴퓨터 비전, 자연어 처리, 음성 인식, 로봇 제어 등 광범위한 분야에서 활용된다.

- 장점: 높은 성능, 다양한 분야에 적용 가능

- 단점: 많은 데이터와 계산 자원 필요,

2. CNN (Convolutional Neural Network, 합성곱 신경망) 모델

- 이미지 처리에 특화된 DNN 모델이다.

- 주요 구성 요소로 합성곱 층, 풀링 층, 완전 연결 층이 존재한다.

- 풀링 층은 특정 맵의 크기를 줄이고 주요 특징을 보존한다.

- 합성곱 연산을 통해 이미지의 지역적 특징을 추출한다.

- 이미지 분류, 객체 탐지, 세그멘테이션 등 컴퓨터 비전 분야에서 널리 사용된다.

- 최근에는 의료 영상 분석, 자율 주행 등으로 응용 범위가 확대되고 있다.

- 장점: 이미지 처리에 높은 성능, 특징 추출 및 학습 용이

- 단점: 데이터 의존성 높음, 계산량 많음

3. RNN (Recurrent Neural Network, 순환 신경망) 모델

이미지 출처: https://www.analyticsvidhya.com/blog/2022/03/a-brief-overview-of-recurrent-neural-networks-rnn/

- 시퀀스 데이터 처리에 특화된 DNN 모델이다.

- 이전 출력이 현재 입력에 영향을 미치는 순환 구조를 가진다.

- 자연어 처리, 음성 인식, 시계열 데이터 분석 등에 활용된다.

- 장점: 시퀀스 데이터 처리에 효과적, 시간적 정보 학습 가능

- 단점: 장기 의존성 문제, 기울기 소실/폭발 문제

4. LSTM (Long Short-Term Memory, 장단기 메모리) 모델

- RNN의 한계를 극복한 모델로, 장기 의존성 문제를 해결하기 위해 순환 처리하는 정보의 양을 조절한다.

- 입력 게이트, 망각 게이트, 출력 게이트를 통해 정보의 흐름을 제어하여 장기 기억을 유지한다.

- 텍스트 생성, 기계 번역, 감성 분석, 음성 인식, 주가 예측 등 다양한 시퀀스 데이터 처리 분야에서 활용된다.

- 긴 시퀀스 데이터에서 우수한 성능을 보인다.

- 장점: RNN의 장기 의존성 문제 해결, 긴 시퀀스 데이터 학습 가능

- 단점: 복잡한 구조, 계산량 많음

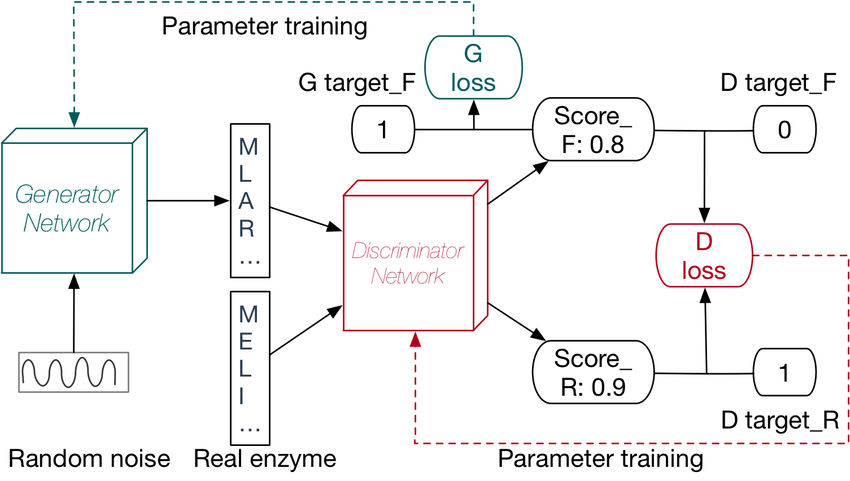

5. GAN (Generative Adversarial Network, 적대적 생성 신경망) 모델

- 생성자와 판별자 두 개의 신경망으로 구성된다.

- 생성자는 가짜 데이터를 생성하고, 판별자는 가짜 데이터와 진짜 데이터를 구분하면서 학습한다.

- 양쪽의 극단적인 데이터를 생성할 수 있다.

- 비용이 매우 높다는 단점이 있다.

- 장점: 새로운 데이터 생성 가능, 다양한 분야에 활용 가능

- 단점: 학습 불안정, 모드 붕괴 문제, 평가 어려움

6. Transformer (트랜스포머) 모델

- 최신 Transformer 모델은 Self-Attention 기술을 사용한다.

- Attention 기술은 입력 시퀀스의 각 부분에 대한 가중치를 계산하여, 특정 부분에 더 집중할 수 있도록 한다.

- 인코더-디코더 구조를 가지며, 인코더는 입력 시퀀스를 벡터화하고, 디코더는 인코더의 출력을 바탕으로 목표 시퀀스를 생성한다.

- 복잡한 시퀀스 변환 작업을 효과적으로 수행할 수 있도록 한다.

- 장점: 병렬 처리 가능, 긴 시퀀스 처리에 효과적, 다양한 task에 높은 성능

- 단점: 높은 계산 복잡도, 데이터 의존성 높음

7. RAG (Retrieval-Augmented Generation, 검색 증강 생성) 모델

이미지 출처: https://qdrant.tech/articles/what-is-rag-in-ai/

- 응답을 생성하기 전, 신뢰할 수 있는 지식을 먼저 검색하여 결과를 개선하는 기술이다.

- 지식베이스 검색 기능을 통해 대화 내용에 맞는 관련 정보를 검색하고 활용한다.

- Wikipedia, Wikidata 등의 대규모 지식베이스와 통합하여 다양한 주제에 대한 정보를 활용할 수 있도록 한다.

- Transformer 기반의 인코더 디코더 구조를 사용한다.

- 대화 맥락을 이해하고 관련 정보를 검색하여 적절한 응답을 생성한다.

- 장점: 정확하고 신뢰성 있는 정보 제공, 최신 정보 반영 가능, 대화 맥락 이해

- 단점: 지식베이스 구축 및 관리 필요, 검색 효율성 중요

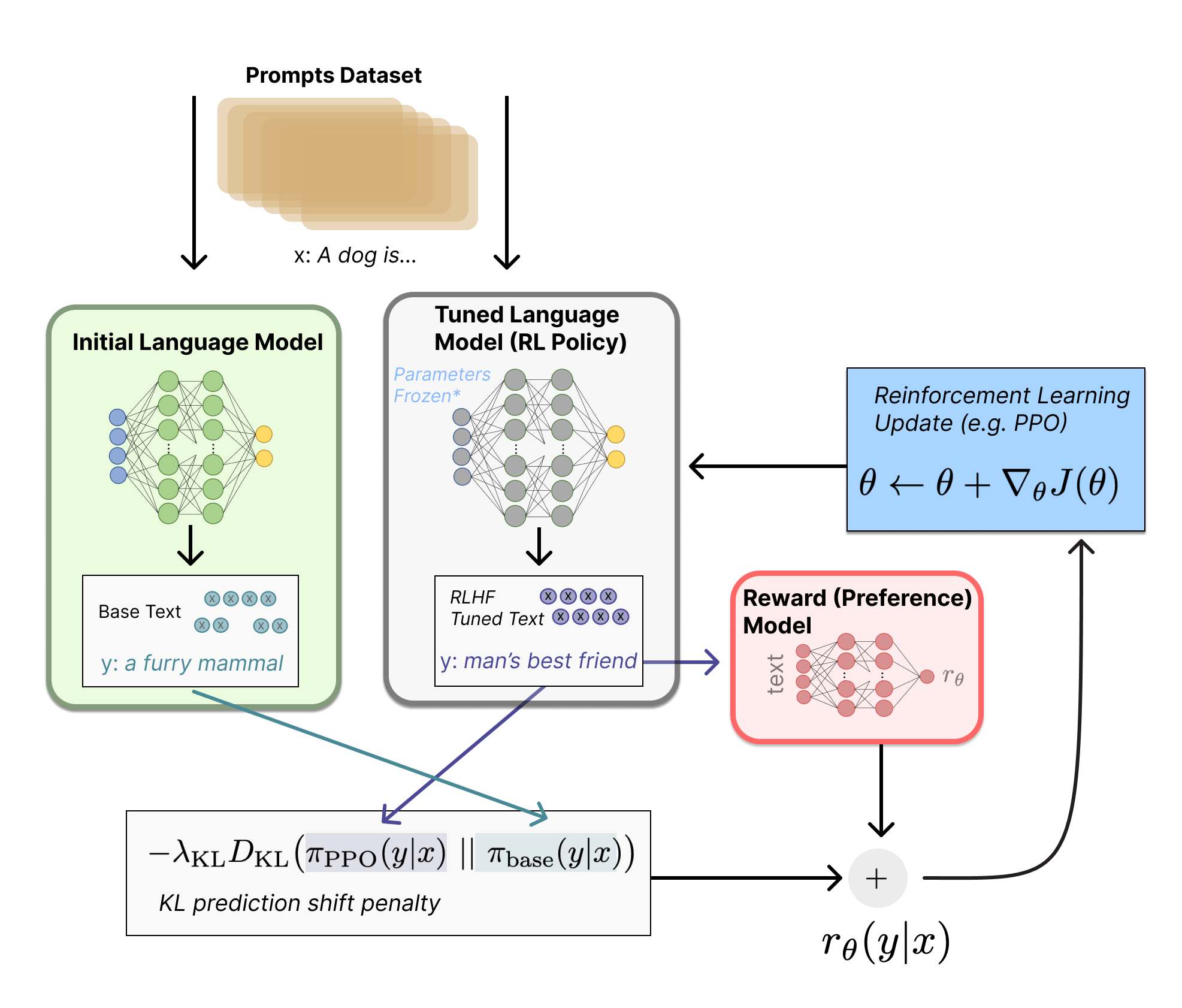

8. RLHF (Reinforcement Learning from Human Feedback, 인간 피드백 강화 학습) 모델

이미지 출처: https://huggingface.co/blog/rlhf

- 대규모 언어 모델과 지식 그래프에서 어떤 정보가 최우선되어야 하는지 모호한 문제를 해결하기 위해 인간의 피드백을 활용하는 학습 단계를 추가한다.

- 인간의 피드백 값이 Reward Model 결과에 추가되어 더 현실적인 출력을 생성한다.

- 장점: 인간의 선호도 반영, 모델 출력 품질 향상, 다양한 task에 적용 가능

- 단점: 인간 피드백 수집 비용, 피드백의 주관성, 보상 모델 설계 어려움

반응형

'AI 서비스 기획' 카테고리의 다른 글

| AI 서비스 기획을 위한, 인공지능 이해하기 (4) | 2024.12.26 |

|---|